X 正在试行一个让 AI 聊天机器人生成社区笔记的计划

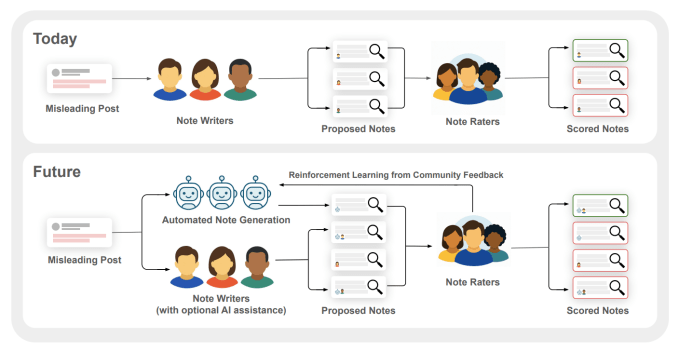

社交平台 Xwill 试行了一项功能,允许 AI 聊天机器人生成社区笔记。 社区笔记是埃隆马斯克 (Elon Musk) 在他拥有的服务(现在称为 X)下扩展的 Twitter 时代功能。 参与此事实核查程序的用户可以贡献评论,为某些帖子添加上下文,然后其他用户会在这些帖子附加到帖子之前对其进行检查。 例如,社区说明可能会出现在不清楚的 AI 生成的视频的帖子上关于它的合成起源,或者作为政客的误导性帖子的附录。 当 Notes 在历史上对过去的评级持不同意见的群体之间达成共识时,它们就会被公开。 社区笔记在 X 上已经取得了足够的成功,激发了 Meta、TikTok 和 YouTube 采取类似的举措——Meta 完全取消了其第三方事实核查计划,以换取这种低成本、社区来源的劳动力。 但人工智能的使用是否有待观察作为事实核查员的聊天机器人将被证明是有益的或有害的。 这些 AI 笔记可以使用 X 的 Grok 或使用其他 AI 工具并通过 API 将它们连接到 X 来生成。 AI 提交的任何注释都将被视为与个人提交的注释相同,这意味着它将经过相同的审查过程以提高准确性。 在事实核查中使用 AI 似乎值得怀疑,因为 AI 产生幻觉或编造并非基于现实的背景是多么普遍。